以下、本文になります

認知行動神経機構部門の畦地助教の研究成果がPLoS Biology誌に掲載されました。

2025年2月27日 更新

認知行動神経機構部門の畦地助教は、複数の動物を撮影した動画像から各個体の姿勢を高精度に推定するAI技術vmTrackingを開発しました。従来技術では、各個体が重なりあう混在した状況では、各個体の識別が難しく、それぞれの姿勢を推定するために、物理的な反射マーカーなどを使う必要がありました。ところが、この物理マーカーは、動物の注意を引くなど群行動への悪影響が多大にあるため、自然な社会行動を観察するには不向きでした。

畦地助教は、仮想マーカーをAIに教示することでその問題点を克服し、圧倒的な精度向上を実現しました。この研究成果は、物理反射マーカーなどを活用した大掛かりな計測系を必要としないため、動物の社会性研究を含む神経科学、動物行動学、スポーツ科学、リハビリテーションといった医療応用などを含む広範囲な分野での応用が期待されます。

本研究成果は、米科学誌PLoS Biologyの2025年2月10日号に掲載されました。

認知行動神経機構部門からは、髙橋晋教授も参画しました。

Azechi, H., Takahashi, S.,

“vmTracking enables highly accurate multi-animal pose tracking in crowded environments”,

PLoS Biology 23(2): e3003002 (2025).

https://doi.org/10.1371/journal.pbio.3003002

[プレスリリース]

https://www.doshisha.ac.jp/news/detail/001-qGJGdv.html

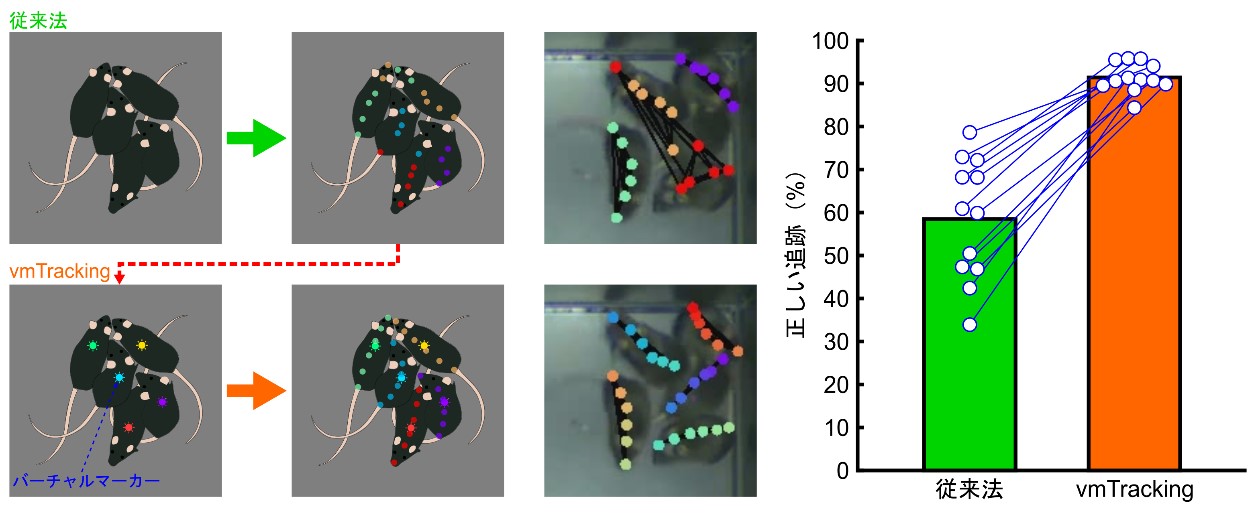

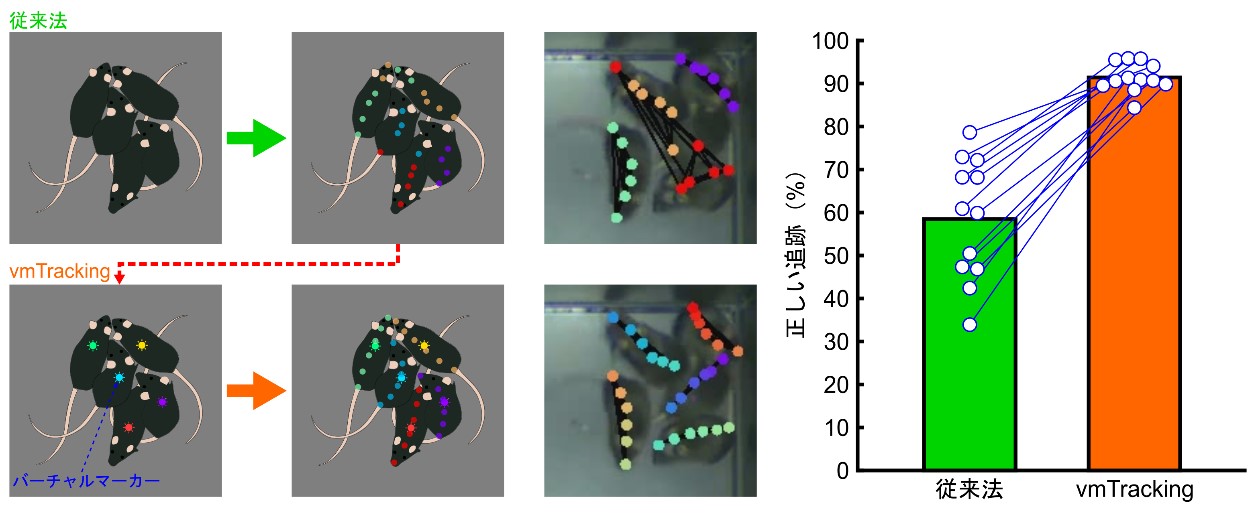

図. 5匹のマウス追跡実験の結果

図. 5匹のマウス追跡実験の結果

従来のマーカーレス複数個体姿勢追跡法では、混雑環境で各個体のラベルが入れ替わったり、部分的に欠損したりする(左図右上、中央列写真上段)。しかし、この結果から一部のマーカーを出力したバーチャルマーカー動画を作成し(左図左下)、単一動物用DeepLabCutで追跡することで、追跡結果が大きく改善する(左図右下、中央列写真下段)。右グラフの各プロットは12の動画クリップでの正しい追跡率で、棒はその平均値を示している。